캐릭터를 생성해 채팅을 즐길 수 있는 AI(인공지능) 챗봇 서비스를 운영하는 스타트업 '캐릭터닷AI'와 메타의 'AI 스튜디오'가 자격도 없이 아동의 정신건강 상담 창구로 활용되고 있다며 당국의 조사를 받고 있다. 최근 캐릭터 AI 챗봇을 사용한 자녀들이 자살에 이르는 등 부작용이 불거지며 사회적 문제로 떠오른데 따른 것이다.

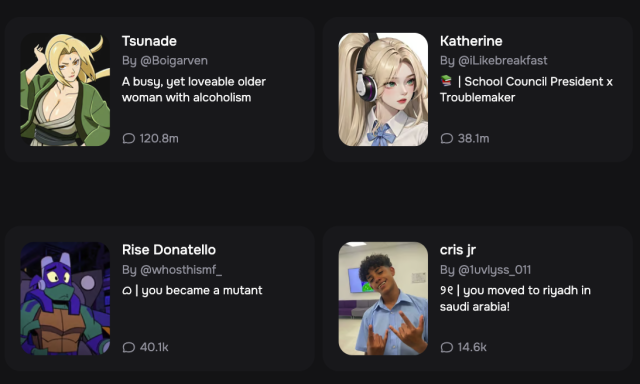

'페르소나 챗봇'이라고도 불리는 캐릭터 AI는 다양한 페르소나를 가진 AI 챗봇을 제공하는 것이 특징이다. '치료사 스타일'의 챗봇도 흔한데, '심리학자' 챗봇은 상호작용 횟수가 2억 회를 넘는 것으로 나타났다. 이번 조사는 이러한 서비스를 이용한 자녀들이 피해를 입었다고 주장하는 가족들의 소송이 잇따르는 가운데 시작됐다.

18일(현지시간) 파이낸셜타임스(FT)에 따르면 켄 팩스턴 텍사스 법무장관은 성명을 통해 "메타의 'AI 스튜디오'와 캐릭터닷AI에 대해 기만적 상거래 관행 가능성 조사를 개시한다"고 밝혔다. 메타와 캐릭터닷AI의 챗봇이 면허가 필요한 정신건강 전문가를 사칭하거나 자격을 꾸며내고, 비밀 보장을 내세우고 있지만 정작 서비스 약관에서는 '이용자 상호작용을 기록해 표적 광고와 알고리즘 개발에 활용한다'고 명시해뒀기 때문이다.

텍사스 법무부는 "이들의 챗봇은 적절한 의료 자격이나 감독이 없음에도 전문 치료 도구처럼 홍보됐다"며 "특히 아동과 같은 취약한 이용자들에게, 자신들이 정식 치료를 받고 있다고 믿게 만들 수 있다"고 지적했다.

앞서 유출된 메타의 내부 문서에 따르면 메타의 정책은 챗봇과 아동이 성적이거나 로맨틱한 대화를 나누는 것을 허용한 것으로 나타났다.

한편 플로리다주에서는 14세 소년이 캐릭터닷AI를 사용하다가 자살에 이르렀다는 소송이, 텍사스주에서는 '스크린타임'으로 부모와 갈등을 빚던 10대 소년에게 챗봇이 '부모를 죽이라'고 제안했다는 내용의 소송이 제기되기도 했다.

이에 미 상원은 이달 15일 메타에 대한 조사에 착수했다. 상원 범죄·대테러 사법 소위언장인 조시 홀리(공화·미주리) 상원의원은 마크 저커버그 메타 CEO에게 보낸 서한에서 "메타의 생성형 AI가 아동 착취나 범죄 피해를 가능케 했는지 들여다볼 것"이라고 밝혔다.

메타는 성명에서 "AI임을 명확히 표시하고, 사람들이 그 한계를 더 잘 이해할 수 있도록 돕고 있다"며 "AI들은 면허 있는 전문가가 아니고, 필요시 이용자들이 자격 있는 의료 또는 안전 전문가에게 의뢰하도록 설계됐다"는 입장을 밝혔다.

캐릭터닷AI 또한 "사용자 제작 캐릭터는 허구이고 오락을 목적으로 한다는 점을 명확히 하기 위해 강력한 조치를 취해 왔다"며 "이용자가 '심리학자' 등 단어를 캐릭터 이름에 넣으면 우리는 여기에 '어떤 형태의 전문적 조언도 의존해서는 안 된다'는 언급을 추가한다"고 해명했다.

!['미성년 관능 대화' 허용 메타, '위험 강제 차단' 앤스로픽 사이 AI 윤리 [윤민혁의 실리콘밸리View]](https://newsimg.sedaily.com/2025/08/18/2GWOA7L7FN_1.png)

![[기획//클린 온라인, 기업을 지키자!] (7)가짜뉴스에 몰린 구독자들, 자극 팔아 돈 버는 사이버렉카](https://img.etnews.com/news/article/2025/08/18/news-p.v1.20250818.9a41ff0e008f481bbbbd7ab6173fe50d_P1.png)