통신위, 신종 사기 전화 경고

소셜미디어에서 목소리 추출

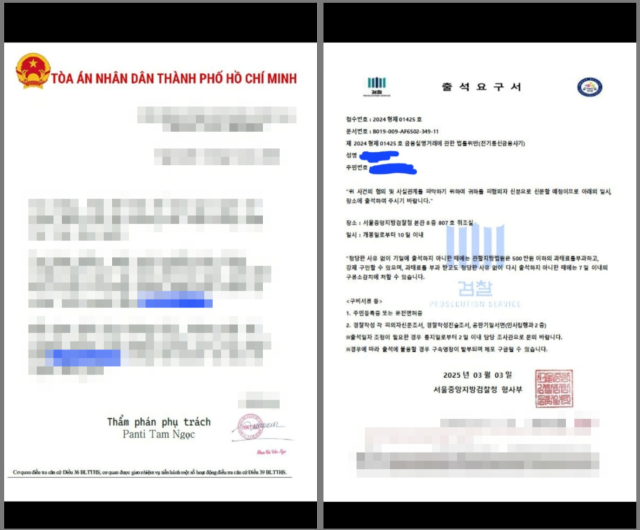

연방통신위원회(FCC)가 노년층을 대상으로 한 인공지능(AI) 음성 복제 사기 전화 주의보를 내렸다. 사기 전화는 주로 소셜 미디어 영상에서 목소리를 추출해, 피해자에게 가족이나 지인이 위험에 처해 있는 것처럼 속여 돈을 요구하는 방식이다.

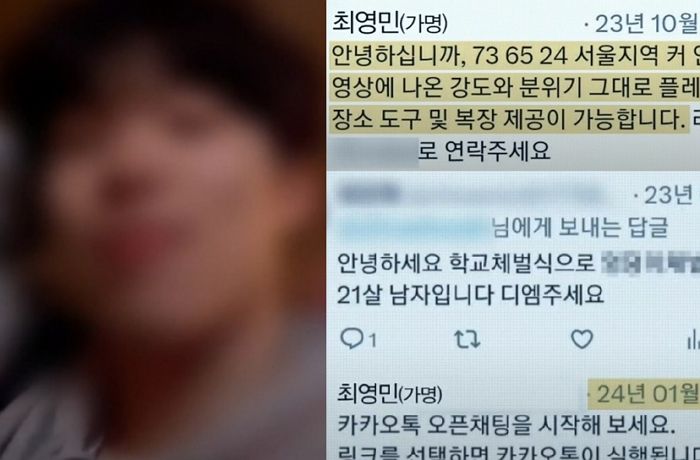

사기범들은 모바일 결제 앱이나 송금, 기프트 카드 등으로 돈을 요구하며 "아무에게도 말하지 말라"고 피해자의 입을 막는다.

연방수사국(FBI) 인터넷 범죄 신고센터(IC3)에 보고된 노인 대상 사기 사례는 2023년 14%나 증가했다. 최근 연방 검찰청은 이와 유사한 수법으로 45개 주에서 범죄를 저지른 혐의로 25명을 기소하기도 했다.

시니어를 겨냥한 사기는 그 정교함이 새로운 수준에 이르고 있다. 이전에도 발신 번호를 조작해 다른 번호에서 전화가 온 것처럼 보이게 하는 기술을 사용해 왔다. 그러나 최근 AI 기술이 사용되면서 짧은 영상으로도 목소리를 진짜처럼 복제할 수 있다. AI 프로그램을 사용하면 사기범들이 원하는 모든 말을 실제 인물이 말하는 것처럼 만들어낸다. 상대를 속일 수 있는 정보는 소셜 미디어에서 얻을 수 있다. 예를 들면, 사기범들은 손자의 전화번호로 전화해 실제 목소리와 구분할 수 없는 말투로 가족만 알 수 있는 사적인 정보를 이야기하며 감옥에서 구해달라고 애원할 수도 있다.

FCC는 "목소리를 믿지 말라"고 경고하며 "연락을 받았다고 주장하는 사람에게 반드시 확인 전화를 걸되 알고 있는 전화번호를 사용하라"고 조언했다.

"아무에게도 말하지 말라"는 것도 흔히 수법이다. 부모에게 말하지 말라는 부탁이나 체포에 대한 비밀 유지 의무가 있어 다른 사람에게 알리면 더 큰 문제가 생길 것이라고 는 위협하는 방식이다.

안유회 객원기자