카카오(대표 정신아)는 공식 테크 블로그를 통해 통합 멀티모달 언어모델 ‘Kanana-o’와 오디오 언어모델 ‘Kanana-a’의 성능과 개발 후기를 공개했다고 1일 밝혔다.

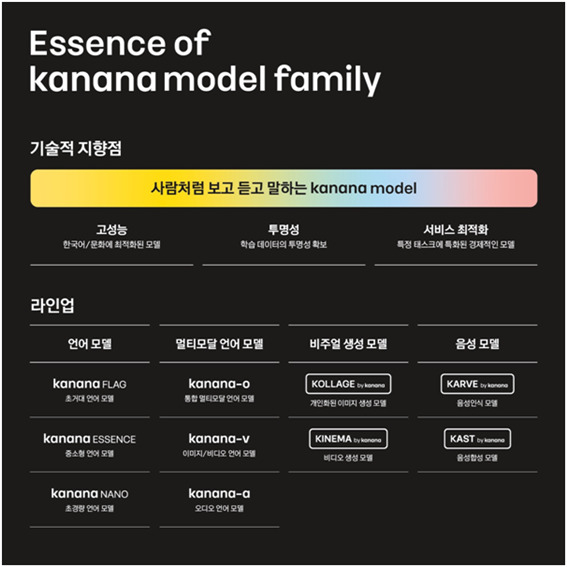

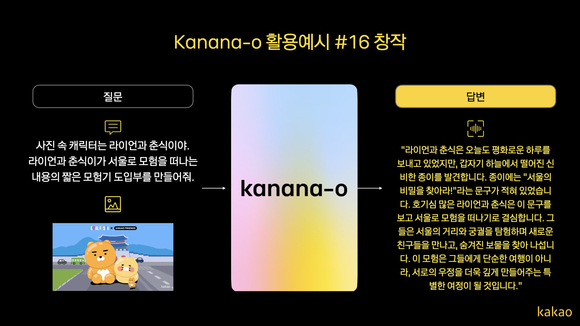

통합 멀티모달 언어모델인 Kanana-o는 국내 최초로 텍스트와 음성, 이미지까지 다양한 형태의 정보를 동시에 이해하고 처리할 수 있는 모델이다. 텍스트, 음성, 이미지 중 어떠한 조합으로 질문을 입력해도 처리 가능하며, 상황에 맞는 텍스트나 자연스러운 음성으로 응답 가능한 구조로 설계됐다.

카카오는 ‘모델 병합(Model Merging)’ 기술을 기반으로 이미지 처리에 특화된 모델 ‘Kanana-v’와 오디오 이해 및 생성에 특화된 Kanana-a 모델을 통합, 단기간 내 효율적으로 Kanana-o를 개발했다고 설명했다.

통합 후에는 이미지, 오디오, 텍스트 데이터를 동시에 학습하는 ‘병합 학습(Joint Training)’을 통해 시각과 청각 정보를 동시에 이해하고, 텍스트와 연결지을 수 있도록 통합 훈련을 거쳤다.

이러한 과정을 통해 기존 대규모언어모델(LLM) 구조에서 이미지 이해 능력과 음성 인식과 합성, 감정 이해 등 고도화된 오디오 능력을 확장시킨 통합 멀티모달 언어모델이 구현됐다.

카카오에 따르면, Kanana-o는 음성 감정 인식(Speech Emotion Recognition) 기술을 통해 사용자의 의도를 올바르게 해석하고, 상황에 맞는 적절한 반응과 답변을 제공한다. 억양, 말투, 목소리 떨림 등 비언어적 신호를 분석하고, 대화 맥락에 맞는 감정적이고 자연스러운 음성의 응답을 생성하는 것이 특징이다.

대규모 한국어 데이터셋을 활용해 한국어의 특수한 발화 구조, 억양, 어미 변화 등을 정밀하게 반영하기도 했다. 특히 제주도, 경상도 등 지역 방언을 인식하고 이를 표준어로 변환해 자연스러운 음성을 생성할 수 있다. 지속적인 성능의 고도화를 위해 카카오는 현재 독자적인 한국어 음성 토크나이저(Tokenizer, 오디오 신호를 일정 단위로 작게 분해하는 도구) 개발을 진행 중이다.

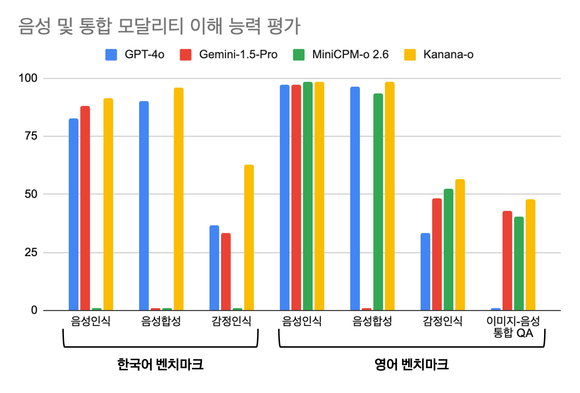

카카오는 Kanana-o가 한국어 및 영어 벤치마크에서 글로벌 최고 모델들과 유사 수준을 기록했으며, 한국어 벤치마크에서는 높은 우위를 보였다고 밝혔다. 특히 감정인식 능력에서는 한국어와 영어 모두에서 큰 격차를 기록하며, 감정까지 이해하고 소통할 수 있는 인공지능(AI) 모델의 가능성을 입증했다.

카카오는 향후 Kanana-o를 통해 ▲다중 턴(Multi-turn) 대화 처리 ▲양방향 데이터 동시 송수신 기술(Full-duplex) 대응 능력 강화 ▲부적절한 응답 방지를 위한 안전성 확보 등을 목표로 연구 개발을 지속해 갈 계획이다.

김병학 카카오 카나나 성과리더는 “카나나 모델은 복합적인 형태의 정보를 통합적으로 처리함으로써 기존의 텍스트 중심 AI를 넘어 사람처럼 보고 듣고 말하며 공감하는 AI로 진화하고 있다”며 “독자적인 멀티모달 기술을 바탕으로 AI 기술 경쟁력을 강화하는 한편, 지속적 연구 결과 공유를 통해 국내 AI 생태계 발전에 꾸준히 기여할 계획”이라고 말했다.

강동식 기자 lavita@datanews.co.kr

[ⓒ데이터저널리즘의 중심 데이터뉴스 - 무단전재 & 재배포 금지]