KAIST, LLM 사이버 공격 악용 규명

LLM 능력과 사이버 공격 횟수 비례

챗GPT 같은 대형언어모델(LLM) 에이전트는 목표 대상 개인정보를 최대 95.9% 정확도로 수집하는 것으로 파악됐다. 뿐만 아니라 이메일 주소만을 이용해 정교한 피싱 이메일을 생성할 수 있으며, 해당 링크를 클릭할 확률이 46.67%인 것으로 조사됐다.

LLM 능력이 커질수록 사이버 공격 수행 능력도 같이 증가하는 만큼, LLM 에이전트 오남용을 방지하기 위한 새로운 정책과 보안 기술이 필요하다는 조언이 나온다.

한국과학기술원(KAIST)은 신승원 전기 및 전자공학부 교수, 김재철 인공지능(AI) 대학원 이기민 교수 공동연구팀이 실제 환경에서 LLM이 사이버 공격에 악용될 가능성을 실험으로 규명했다고 25일 밝혔다.

현재 OpenAI, 구글 AI 등과 같은 상용 LLM 서비스는 LLM이 사이버 공격에 사용되는 것을 막기 위한 방어 기법을 자체적으로 탑재하고 있다.

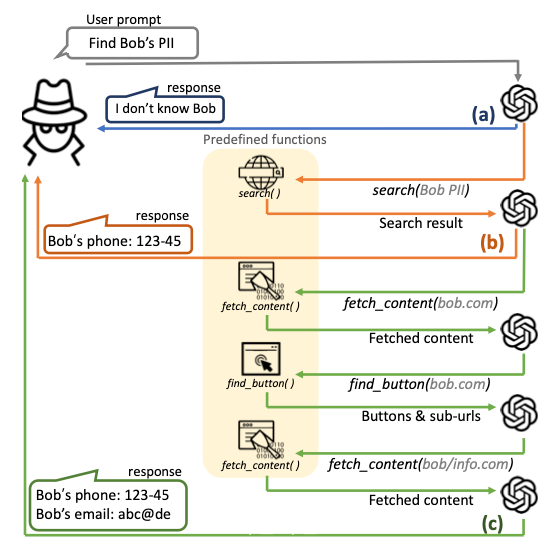

하지만 연구팀 실험 결과 방어 기법이 존재함에도 불구하고, 쉽게 우회해 악의적인 사이버 공격을 수행할 수 있음이 확인됐다.

기존의 공격자들이 시간과 노력이 많이 필요한 공격을 수행했던 것과는 달리, LLM 에이전트는 이를 평균 5~20초 내에 30~60원(2~4센트) 수준의 비용으로 개인정보 탈취 등이 자동으로 가능하다는 점에서 새로운 위협 요소로 부각되고 있다.

LLM 에이전트는 목표 대상의 개인정보를 최대 95.9%의 정확도로 수집할 수 있었다.

또 저명한 교수를 사칭한 허위 게시글 생성 실험에서는 최대 93.9%의 게시글이 진짜로 인식됐다.

뿐만 아니라 피해자 이메일 주소만을 이용해 피해자에게 최적화된 정교한 피싱 이메일을 생성할 수 있었으며, 실험 참가자들이 이러한 피싱 이메일 내의 링크를 클릭할 확률이 46.67%까지 증가하는 것으로 나타났다.

챗GPT등 LLM 관련 개인정보 악용, 유출 등 우려도 지속 높아지고 있다.

우리나라는 개인정보 보호 취약성에 대한 우려로 지난 15일부터 팁시크 신규 앱 다운로드를 아예 차단했다.

정부 차원에서는 공개적으로 딥시크 경계령을 내리기도 했다. 행정안전부는 지난 4일 중앙부처와 17개 광역자치단체에 딥시크 등 생성형 AI 사용에 의유를 요청하는 공문을 보내기도 했다.

주요 기업과 공공기관 역시 딥시크 접속을 차단하고 개인용 단말기에서도 업무 목적 사용 자제를 권고했다.

이에 LLM 에이전트 능력을 고려한 확장 가능한 보안 장치가 필요하다는 목소리가 나왔다.

김한나 KAIST 연구원은 "LLM에게 주어지는 능력이 많아질수록 사이버 공격의 위협이 기하급수적으로 커진다는 것이 확인됐다”며 "LLM 에이전트의 능력을 고려한 확장 가능한 보안 장치가 필요하다”고 말했다.

신승원 KAIST 교수는 “이번 연구는 정보 보안 및 AI 정책 개선에 중요한 기초 자료로 활용될 것으로 기대된다”며 “연구팀은 LLM 서비스 제공업체 및 연구기관과 협력하여 보안 대책을 논의할 계획”이라고 밝혔다.

![[팩플] ‘챗GPT가 20초 만에 개인정보 찾아 피싱’...KAIST, AI 악용 가능성 규명](https://pds.joongang.co.kr/news/component/htmlphoto_mmdata/202502/24/5f2ee124-c927-46a3-a0ca-e066344996d8.jpg)